随着ChatGPT引发新一轮人工智能(AI)热潮,而其背后带来的能耗问题也持续引发关注。

今年4月10日,芯片巨头 Arm公司CEO哈斯(Rene Haas)公开表示,包括ChatGPT在内的 AI 大模型需要大量算力,预计到2030年,AI 数据中心将消耗美国20%至25%的电力需求,相比今天的4%大幅增加。

公开数据显示,目前,ChatGPT每天需要处理超过2亿次请求,其电量消耗高达每天50万千瓦时。一年时间,ChatGPT光电费就要花2亿元人民币。

这意味着,ChatGPT日耗电量是普通家庭的1.7万倍以上。(美国商业用电一度约为0.147美元也就是1.06元,相当于一天53万元)

据荷兰咨询机构负责人Alex de Vries预计,到2027年,AI 行业每年将消耗850亿~1340亿千瓦时的电力,相当于瑞典或荷兰一个欧洲国家一年的总用电量。

马斯克判断,电力缺口最早可能会在2025年发生,“明年你会看到,我们没有足够电力来运行所有的芯片”。

OpenAI CEO奥尔特曼(Sam Altman)也预计,AI 行业正在走向能源危机,未来 AI 技术发展将高度依赖于能源,人们也需要更多的光伏和储能产品。

这一切都显示出,AI 即将引爆全球新一轮“能源战争”。

不止是芯片,AI 还被能源“卡脖子”

过去500多天里,ChatGPT引发全球新一轮 AI 大模型和算力需求热潮。

微软、谷歌、Meta、OpenAI等多家全球科技巨头开始疯抢 AI 芯片,甚至亲自下场“造芯”,总规模超过数十万亿元美金。

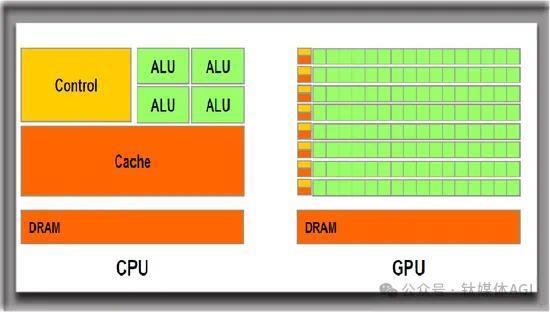

实际上,AI 本质上是一种计算机技术和处理信息的技术,背后则需要大量GPU芯片,更底层则是大量电能、水力、风能、资金等资源的支持。

早在1961年,在IBM公司工作的物理学家拉尔夫·兰道尔(Rolf Landauer)发表了一篇论文,提出了后来被称为“兰道尔原理”(Landauer's Principle)的理论。

这一理论认为,计算机中存储的信息发生不可逆的变化时,会向周围环境散发一点点热量,其散发的热量和计算机当时所处的温度有关——温度越高,散发的热量越多。

兰道尔原理连接起了信息和能量。更具体地说,它连接到了热力学第二定律上。因为逻辑上不可逆的信息处理操作,也就意味着湮灭了信息,这会导致物理世界中熵的增加,从而消耗能量。

这一原理自提出以来遭受过不少质疑。但近十几年来,“兰道尔原理”已被实验证明。

2012年,《自然》杂志发表了一篇文章,研究团队首次测量到了一“位”(bit)数据被删除时释放的微量热量。后来的几次独立实验,也都证明了“兰道尔原理”。

过去10多年间,现代电子计算机在计算时实际消耗的能量,是兰道尔理论值的数亿倍。而科学家们一直在努力寻找更高效的计算方法,以降低成本。

如今,AI 大模型爆发,它确实需要大量计算。因此,AI 不止被芯片“卡脖子”,还被能源“卡脖子”。

马斯克近期也在“博世互联世界2024”大会上表示,一年多以前,短缺的是芯片,明年你会看到电力短缺,无法满足所有芯片的需求。

中国科学技术信息研究所人工智能中心副主任李修全也表示,近年来, AI 大模型规模、数量都在高速增长,也带来对能源需求的快速增加。尽管短期内还不会很快出现“缺电”等问题,但未来大规模智能化时代来临后的能源需求激增不容忽视。

|